A Anthropic, um dos nomes proeminentes no desenvolvimento de inteligência artificial, mantém conversas com altos escalões do governo Trump. A situação ocorre mesmo após a empresa ter sido sinalizada como risco à cadeia de suprimentos pelo Pentágono, indicando uma complexa relação entre a inovação em IA e a segurança nacional.

O que aconteceu

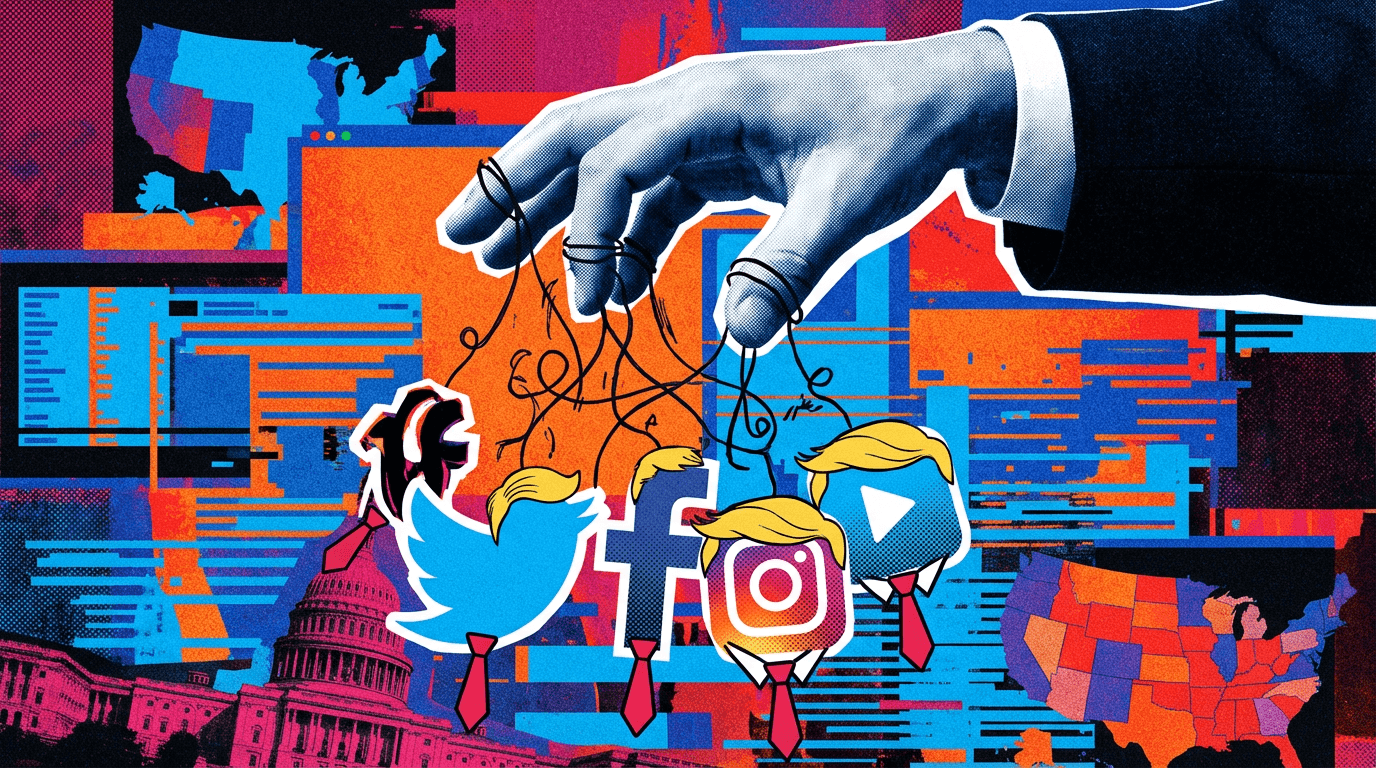

Apesar de ter sido recentemente classificada como um risco à cadeia de suprimentos pelo Departamento de Defesa dos Estados Unidos, a Anthropic continua a engajar em diálogos com membros de alto nível da administração Trump. Esta designação pelo Pentágono sugere preocupações sobre a segurança e a confiabilidade dos sistemas de IA da Anthropic em contextos militares ou de infraestrutura crítica. No entanto, a persistência das conversas indica que a empresa busca ativamente mitigar essas preocupações ou demonstrar sua capacidade de atender aos requisitos de segurança estabelecidos. A fonte original detalha que, mesmo sob escrutínio, a comunicação com figuras governamentais importantes não cessou, sugerindo um esforço contínuo para navegar o ambiente regulatório e político. O TechCrunch AI, em sua matéria de 18 de abril de 2026, aponta para essa aparente contradição como um ponto de atenção no setor de IA.

Por que importa

Para o mercado brasileiro de tecnologia e inteligência artificial, a dinâmica entre empresas de IA e governos, especialmente os dos Estados Unidos, tem implicações diretas. A forma como a Anthropic gerencia sua relação com o governo americano, particularmente em resposta a preocupações de segurança nacional, pode estabelecer precedentes para a regulamentação e a adoção de IA em outros países. A designação de risco pelo Pentágono levanta questões sobre a auditoria, a transparência e a segurança intrínseca dos modelos de linguagem grande (LLMs) e outras tecnologias de IA desenvolvidas por empresas privadas. Para o Brasil, que busca fortalecer seu próprio setor de IA, entender esses processos é fundamental para a formulação de políticas públicas e para a atração de investimentos em um ambiente seguro e confiável. A capacidade de empresas de IA de equilibrar inovação e conformidade com normas de segurança é um fator decisivo para sua aceitação e expansão global.

O que esperar

O desenrolar dessa relação entre a Anthropic e o governo Trump será crucial para definir os próximos passos da empresa no cenário regulatório. É provável que a Anthropic intensifique seus esforços para demonstrar a robustez de suas medidas de segurança e a confiabilidade de seus produtos. Isso pode incluir auditorias mais rigorosas, desenvolvimento de novas salvaguardas técnicas e maior transparência sobre seus processos de treinamento e validação de modelos. O governo, por sua vez, provavelmente continuará a avaliar os riscos e benefícios da colaboração com empresas de IA, buscando um equilíbrio entre o avanço tecnológico e a proteção de interesses nacionais. A forma como essa situação for resolvida pode influenciar a maneira como outras nações e órgãos governamentais abordam a segurança da IA no futuro. Acompanhar as atualizações sobre o caso será importante para entender as tendências em regulamentação e segurança de IA.